WHAT WE DO

CNN推論 / LLM推論アクセラレータを、FPGAからASICまで。

SpiceEngineは、専用アクセラレータの設計・実装を一貫して提供します。まずFPGAで実証し、IP化を経てASICへ進む段階戦略を採用します。

Strengths

段階戦略

FPGA → IP化 → ASIC

価値指標

画像認識1ms / 消費電力5W未満

適用範囲

エッジからクラウドまで

CNN推論アクセラレータ

CNN推論でJetson比21倍を掲げるアクセラレータ。低遅延かつ省電力なコンピュータビジョン処理に向けた設計を進めています。

- データフロー最適化による高速化

- 帯域とメモリの用途別最適化

- FPGA実装からASIC展開まで同一思想で接続

LLM推論アクセラレータ

LLM推論に向けた専用アクセラレータを開発。高効率推論のために、専用ハードウェアでオーバーヘッドを抑える設計を採用します。

- モデルと演算特性に合わせた専用実装

- データセンターからエッジまでの展開を想定

- 段階戦略に沿った実装・評価フロー

Technology

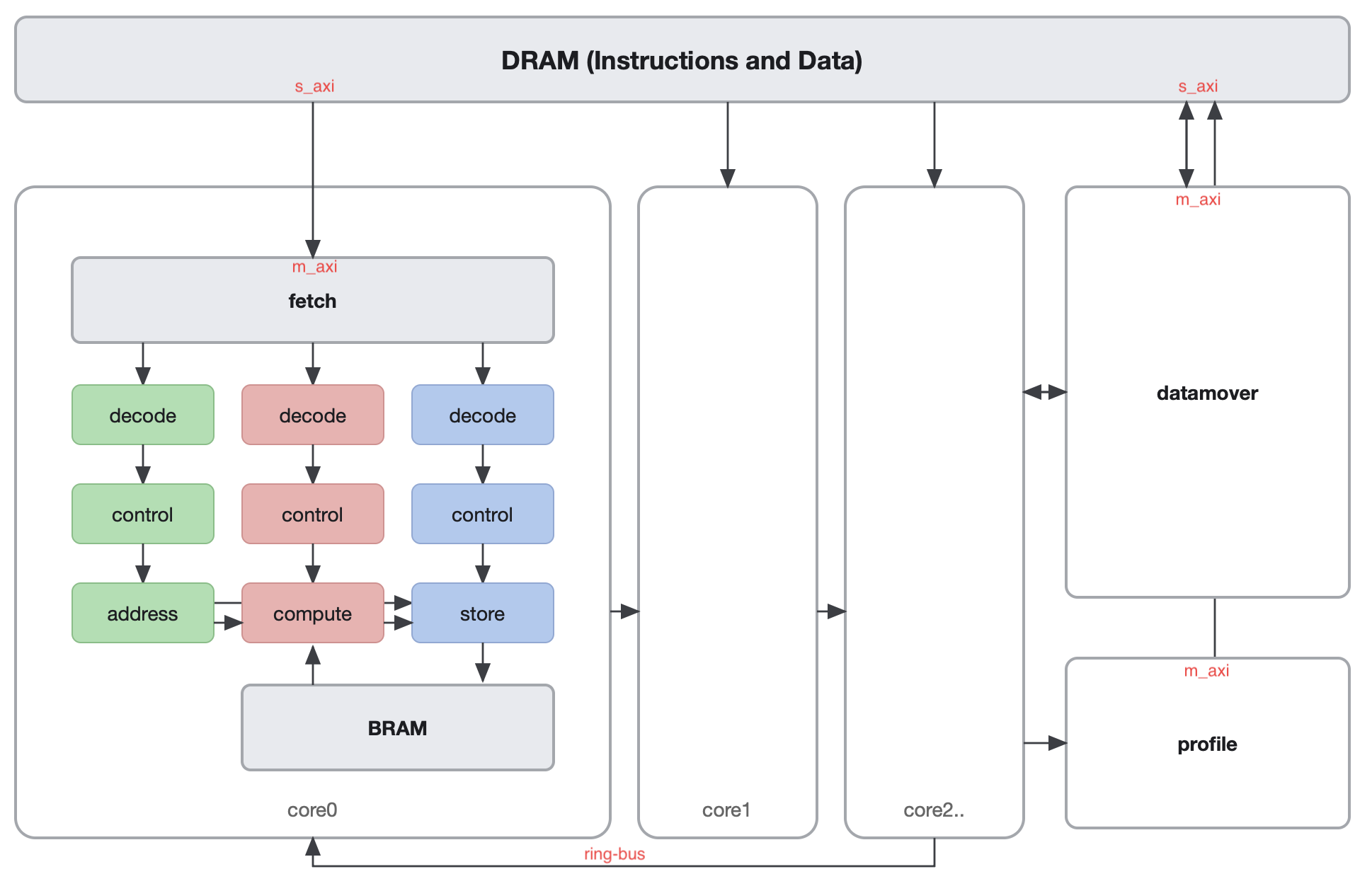

データフローアーキテクチャと専用ハードウェア設計を組み合わせ、CPU/GPUのオーバーヘッド抑制を狙います。Wasabi2.0は、モデル圧縮・マルチコア・8-bit量子化の統合として紹介されています。

Use Cases / Applications

- 低遅延が要求されるエッジAI推論

- 省電力が重要な組み込みビジョン処理

- データセンターとエッジの一貫運用